与「性感外拍」相关的搜索结果

性感外拍 贴吧

一个关键词就是一个贴吧,路径全站唯一。

用户

未找到

包含 性感外拍 的内容

最新海外旅拍性感白纱写真《white》上新,家人们新造型吗?

The latest overseas travel photo album featuring sexy white wedding gown, "White," is now available. Is this a new look for the family?

#户外露出# #性感外拍# #性感写真# #纯欲# #反差女友#

显示更多

夜色撩人,比基尼的我,是不是让你心动加速?

【新品来袭】最新夜景性感外拍写真《魅影》惊艳上线,期待你来解🔓

The night is seductive, my bikini like self, does it make your heart race faster?

#性感写真# #比基尼# #外景写真# #夜景# #纯欲# #反差女友#

显示更多

她从海浪中走来🌊

最新海景写真大片《海边维纳斯》上新,张张都是精美桌面🥰

She walked from the waves 🌊

The latest sea view photo shoot 'Venus by the Sea' has been released, with exquisite tabletops on every photo 🥰

#海景人体# #外景写真# #性感写真# #纯欲# #人体外拍#

显示更多

记得Defi Summer 20年到22年这三年时间,大家经常感慨的一句话就是“币圈一天,人间一年”

因为技术迭代太快了,每天都有数不行的新东西出来,几天不看就跟不上节奏

现在这个感觉在币圈彻底消失,在AI那边出现了,每天的新东西就看不完,真的看不完

正好这几天看到圈里讨论Cerebras的帖子多了起来,昨天还看到不少路演信息,毕竟14号要挂牌交易。之前在Amber做分享的时候也单独讲过这个公司(当时用的那页PPT放在文末),所以简单说下我对Cerebras的判断

先说结论:这家公司很有意思,但核心变量不一定是他们造的芯片本身,而是未来AI的workload形态会是成什么样。

先简单说下它是干嘛的,防止有老铁还没看Cerebras

它最核心的技术,就是wafer-scale chip(晶圆级芯片),简单理解就是别人还在用“邮票大小”的芯片,它直接把整片晶圆做成一颗超大处理器,再配上超大 SRAM,把大量数据尽量留在本地高速处理,减少传统GPU最头疼的memory bottleneck。现在海力士美光涨上天就是因为HBM这东西太抢手,Cerebras是直接绕开了对HBM的依赖

很多人看到 Cerebras最牛逼的benchmark:推理速度比GPU快10-15倍,第一反应就是下一个英伟达?!

先别急。

这个benchmark最大的问题,是默认AI的核心需求永远是“更快吐token”。

如果只是人类盯着ChatGPT聊天,这故事其实没那么性感。你每秒吐 30 个 token,我已经快读不过来了。再翻10倍,边际体验提升几乎为零。

真正有意思的是 Agent。

Agent不读字,Agent消费Token。速度直接等于生产力。

一个OpenClaw/Hermes agent,如果要读网页、写计划、调 API、跑代码、报错重试、继续执行,一个任务可能要几十次 inference call。

每次 2 秒,任务就是分钟级体验。

每次 200ms,就是另一个世界。

所以 Cerebras更值得关注的地方,是 AI worker 这条线,而不是单纯的chatbot加速。

但问题来了 - 它的magic来自 wafer-scale + 超大SRAM,本地访问极快。但SRAM这东西有天然 tradeoff,速度快,容量贵,大模型塞不下就必须拆分。

而一旦拆分,chip-to-chip communication 就上来了。

LLM inference里最怕通信的恰恰是 decode 阶段。token 是一个一个往外吐的,每多一次 hop,延迟就是硬加上去,没法隐藏。

所以 Cerebras能不能成,关键根本不在“比 GPU 快几倍”,而是未来 AI 的主流计算形态到底是什么。

1. 时间线一 - 未来几年还是 前沿超大模型一统天下,动不动几千亿甚至万亿参数,所有请求都让超大模型自己处理,那 Nvidia的distributed infra 依然最舒服,Cerebras的速度优势会被通信损耗吃掉很多。

2. 时间线二 - MoE、蒸馏、量化这些技术如果继续快速进步,未来两年70B左右的模型做到今天700B模型 80%-90% 的效果,我一点都不意外。(这里要强烈感谢Deepseek一大波!)

如果世界往这个方向走,故事就变了。

大模型负责 planning / judgement / orchestration。

真正执行任务的大量 worker model 落在 30B-70B 这个区间。

这些模型足够聪明,又刚好能吃到高速本地推理带来的红利。

Agent 世界里,大部分token根本不需要最聪明的大脑。很多工作本质就是执行层体力活:浏览网页、改代码、调工具、retry、继续跑流程。

这个 topology一旦成立,Cerebras就直接进入自己的甜区

3. 时间线三 - 未来推理是端侧为主,用的都是8B,14B的这些小模型,那GPU也能跑的很好,甚至专用的ASIC芯片效率更高,这个场景下Cerebras的优势和护城河也就不高了

换句话说,超大模型云端推理或者超小模型的端侧推理这两个平行宇宙,Cerebras的优势都不够明显,只有主流推理落在32B-70B中等模型这个Size,正好“Big enough to stress GPU memory, Small enough to fit locally” 才是Cerebras最能大展身手的世界

所以我对Cerebras的判断是,300多亿的市值,短期看订单,财务报表这些数据,长期赌的则是未来Agent时代的计算范式到底落在哪个平行宇宙的时间线上

显示更多

臭猴子

你说……

这山岭外的世界,究竟是什么样的?

出镜:@_nnian

最新主题写真《四妹》上新,完整版私信🤤赶趟黑神话末班车,来不及解释了,快上车~

#年年# #黑神话悟空# #性感写真# #反差#

Stinky monkey

you say……

What is the world outside this mountain like?

The latest themed photo "Four Sisters" is released, the full version can be sent to private message 🤤 Catch the last train of Black Mythology, there is no time to explain, hurry up and get on the bus

显示更多

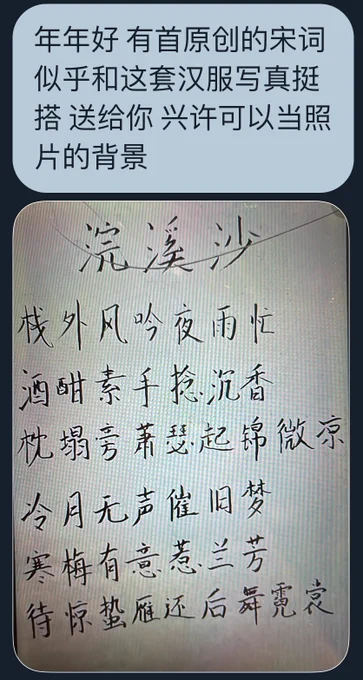

《浣溪沙》

栈外风吟夜雨忙

酒酣素手捻沉香

枕塌旁萧瑟起锦微凉

冷月无声催旧梦

寒梅有意惹兰芳

待惊蛰雁还后舞霓裳

这位粉丝真是太有才了,感谢写的词送我,真的好棒😍

汉服性感写真《霓裳》开始预购,预览入群可看哦

#年年nnian# #汉服写真# #古风# #性感纯欲# #情欲写真# #反差#

显示更多

黑系穿搭封神,妩媚氛围感直接拿捏,谁能拒绝这般温柔又性感的模样

高冷又魅惑的氛围感女神,黑裙衬得身姿曼妙,眼神自带故事感,一眼沦陷

显示更多

超绝白丝配修长美腿,白丝丝袜搭配奶牛雪糕。一口下去甜美无比。清纯又带点小性感。

一定要看下去,后面还有惊喜,魅力十足超吸睛

显示更多

水手风甜酷穿搭上线✨

精致小蛮腰搭配修长美腿,白丝配水晶高跟,身姿窈窕又撩人,清纯又带点小性感,氛围感直接拉满,魅力十足超吸睛

显示更多

所有人都在买GPU和存储。没有人告诉你光模块公司的总市值比美光还低

我想从一个反常识的问题开始:GPU是AI的大脑,存储是AI的记忆。那光是什么?光是AI的神经系统。但神经系统从来不是最先被注意到的。存储已经涨了10倍,GPU更不用说。光的时代,刚刚开始。

1. 先说一个结构性的错误定价

在Nvidia的NVL72机架里,光模块的采购金额占到整个机架的20%。2026年全球AI光收发器市场规模预计从2025年的$165亿增长到$260亿,同比增速超过57%——这是半导体赛道里增速最快的子领域之一。 但所有光模块公司的总市值,比美光一家还低。这个错误会被纠正。问题只是什么时候。

2. 光和存储不一样的地方

存储的接力是季度级别的事件——供需拐点,财报超预期,市场重新定价,SNDK从$200涨到$900,这个过程很快。光的接力是年级别的结构性变迁,因为光的技术路线本身正在发生一次范式转移:

第一阶段(现在):可插拔光模块

800G → 1.6T → 3.2T

线性增长,随数据中心扩张

第二阶段(2026下半年):近封装光学NPO

光模块移向芯片旁边

需求非线性跳升

第三阶段(2027-2028):共封装光学CPO

光引擎直接封装进芯片

这是终局,也是最大的价值重构

Meta在OFC 2026分享了大量数据,证明CPO比可插拔光收发器更可靠,成本更低,功耗更少。Nvidia在GTC展示了CPO将在2027/28年用于Scale-Up互连。5年内所有AI数据中心互连都将是光。 这不是预测,是物理定律。铜在高速率下信号损耗太大,功耗太高,距离太短。光没有这些问题。

3. 光在吃铜,不只是光吃光

生成式AI集群需要比传统云服务多10到100倍的光纤,正在把现有铜互连逼到物理极限。 这是大多数人没想到的逻辑——光的增长不只来自数据中心规模的扩大,还来自光替代铜的渗透率提升。每一代迭代,光吃掉更多铜的市场。这是双重驱动,不是单一驱动。

4. 产业链七个卡位,从上游到下游

现在我来把整条产业链拆清楚。

七个公司,覆盖从最上游的衬底到最下游的网络设备。

🔬 最上游:硅光衬底 $SOI

做的是硅光PIC的衬底材料——整个产业链最上游的原材料。没有SOI的衬底,硅光芯片就没有基础。护城河极高,几乎没有竞争对手能短期内介入。和TSEM形成上下游绑定:SOI提供衬底,TSEM代工成芯片。

🏭 代工层:硅光晶圆厂 $TSEM(Tower Semiconductor)硅光版本的台积电。

今天刚刚发生的重大事件:

TSEM宣布签署$13亿的2027年硅光合同,收到$2.9亿产能预付款,2028年还有更大合同在谈判中。计划资本支出$9.2亿专门用于硅光扩产,Q2营收指引$4.55亿同比增22%。

TSEM最聪明的地方在于:它不赌哪条技术路线赢。

可插拔、NPO、CPO,三条路线都用TSEM代工。就算市场对技术路线判断错了,TSEM依然受益。这是光通讯产业链里确定性最高的picks-and-shovels。

💡 激光器层:光的心脏

光模块的核心是激光器。没有激光器,光模块什么都不是。

激光器分两条技术路线:

磷化铟(InP)路线——$LITE(Lumentum)

LITE是目前唯一能量产200G每lane EML激光器的供应商,是1.6T收发器的关键零件。Nvidia预先锁定了LITE的EML产能,推迟交货期超过2027年。

Nvidia向LITE投资$20亿,用于加速AI基础设施光学技术。LITE CEO称2026年是激光器芯片销售的"突破年",刚收到历史上最大的CPO超高功率激光器采购承诺。

LITE的护城河是时间积累的——InP激光器的制造需要极其精密的工艺,20年积累的经验是任何竞争对手短期无法复制的。而且LITE不只押注现在:EML是可插拔时代的命门,ELS外置激光器是CPO时代的命门,OCS光路交换机是未来AI集群的光学路由器。

三个产品线覆盖了光通讯从现在到2030年的完整需求。

硅光(SiPho)激光器路线——$SIVE(Sivers Semiconductors)

Sivers专注于CPO系统的高性能InP激光阵列,Jabil合作是第一个商业验证信号,证明技术正在从研究走向真实超大规模部署。 SIVE不是要打败LITE,而是作为CPO时代激光器供应链里的补充供应商——当LITE和COHR产能不足时,SIVE是下一个选项。整个CPO产业的激光器供应严重短缺,补充供应商的价值会被重新定价。

🔭 光学系统层:从组件到整合

$COHR(Coherent Corp)

COHR最新Q3财报:营收$18.1亿同比增21%,数据中心和通信板块$14亿,同比增40%。Nvidia同样投资$20亿入股COHR。COHR是整个光通讯赛道里垂直整合程度最高的公司。从InP晶圆到激光器到光模块到系统,全部自己做。COHR正在扩大6英寸InP晶圆产能,这是推动毛利率持续提升的核心驱动力——规模越大,每片晶圆的成本越低,利润越高。

LITE和COHR的关系是竞争者也是互补者:

LITE:激光器专家,EML垄断,聚焦

COHR:光学系统整合商,体量更大,更全面

🏗️ 物理基础设施层:光纤和连接 $GLW(Corning)

Corning是光通讯产业链里最让人意外的标的——一家成立于1851年的玻璃公司,正在成为AI基础设施的核心受益者。

Q1 2026光学通信业务增长36%,分部净利润增长93%。2028年营收目标$300亿,2030年$400亿,内含年化增速19%。两个额外的超大规模云厂商签署了长期协议。

Nvidia命名Corning为下一代AI基础设施光连接合作伙伴,投资$5亿+最高$32亿股权,在美国建三座专属光学工厂。

Corning做的是光纤、线缆和连接器——不是最性感的产品,但是不可或缺的基础设施。

城市要运转,不只需要主干道,还需要所有的小路、接头、路牌。

Corning做的就是光通讯世界里的所有"小路和接头"。

而且这些"小路和接头"是消耗品——每建一个数据中心都需要,每升级一个机架都需要。

📡 网络层:AI时代的网络基础设施 $NOK(Nokia)

Nokia是这七个标的里最被市场误解的。大多数人还在用"翻盖手机公司"的眼光看Nokia。

Nokia 2026营收预期同比增长7.5%,EPS增长21.2%,光网络业务增速20%,AI和云业务增速49%,单季度新增€10亿AI和云订单。

Nokia做的是什么?

光传输网络(OTN)——把数据中心之间用光连接起来的骨干网络。这是Scale-Across的核心基础设施。

Nokia的第六代超相干光学技术PSE-6s,是目前全球少数能实现800G甚至1.2T长距离光传输的技术之一。

Nokia收购Infinera之后,从"转卖别人芯片的公司"升级为"拥有自己光芯片工厂的公司"——同样的技术路线,市场给LITE估值66.5倍,给COHR估值35倍,Nokia只有30.8倍Forward PE。

这个估值差距是最大的错误定价之一。

七个标的的完整产业链图

最上游

SOI(硅光衬底)

↓

TSEM(硅光代工)

↓

激光器层

LITE(InP EML,可插拔+CPO)

COHR(垂直整合,光学系统)

SIVE(CPO激光阵列,高赔率)

↓

物理基础设施

GLW(光纤、线缆、连接器)

↓

网络层

NOK(光传输网络,骨干连接)

每一层都有自己不可替代的护城河。

每一层都在受益于同一个趋势。

6. 为什么是现在?

2026到2027年是在1.6T供应链建立立足点的关键时期,在一线客户的设计导入将决定长期赢家。现在是design-in阶段——产品正在被超大规模客户选中和锁定。等量产阶段到来,市场才会充分定价这些公司的价值。

在design-in阶段买入,等量产阶段收获——这是光通讯投资最好的时机。

7. 仓位逻辑

高确定性(重仓):

TSEM → 今天$13亿合同,产业链里最硬的催化剂

LITE → EML垄断+Nvidia锁定,现在到2028年都受益

COHR → 垂直整合,体量最大,Nvidia $20亿入股

中等确定性(配置):

GLW → Nvidia直接合作,物理基建不可或缺

NOK → 最被低估的估值,但故事兑现需要更多时间

高赔率(小仓位):

SOI → 和TSEM绑定,护城河高但流动性低

SIVE → CPO时代的纯粹赌注

8. 光会接力存储吗?

会。但不一样的方式。存储的接力是一次性的价格重估——供需拐点到来,几个季度内完成定价。

光的接力是分阶段的持续重估——

2026年:可插拔1.6T带来第一波

2027年:CPO开始量产带来第二波

2028年:Scale-Up全面光化带来第三波

三波叠加,才是光通讯超级周期的全貌。存储让你在一年内赚了10倍。光可能让你在三年内赚同样多,但过程更平稳,确定性更高。

最后一句话

光通讯不是一个新故事,是一个被重新发现的旧故事。

光纤已经存在几十年了,但AI让这个故事的量级发生了质变。每当数据中心需要更高密度、更低功耗、更远距离的连接时,答案永远是光。

#光通讯# #TSEM# #LITE# #COHR# #GLW# #NOK# #SOI# #SIVE# #CPO# #硅光# #光模块# #AI基建# #数据中心# #存储接力# #Nvidia# #美股# #USStocks# #SiliconPhotonics# #CoPackagedOptics# #EML# #光互连# #AIInfrastructure# #光纤# #Nokia# #Corning# #Coherent# #Lumentum#

显示更多